Programming

#Pocket

#NLP

#Dataset

#LanguageModel

#Evaluation

#MultiLingual

Issue Date: 2025-08-19 [Paper Note] AutoCodeBench: Large Language Models are Automatic Code Benchmark Generators, Jason Chou+, arXiv'25 SummaryAutoCodeGenを提案し、手動注釈なしで高難易度の多言語コード生成データセットを自動生成。これに基づき、3,920の問題からなるAutoCodeBenchを導入し、20のプログラミング言語に均等に分配。30以上のLLMsを評価した結果、最先端のモデルでも多様性や複雑さに苦労していることが明らかに。AutoCodeBenchシリーズは、実用的な多言語コード生成シナリオに焦点を当てるための貴重なリソースとなることを期待。 Commentpj page:https://autocodebench.github.io/元ポスト:https://x.com/tencenthunyuan/status/1957751900608110982?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Pocket #NLP #Dataset #LanguageModel #Evaluation #Reasoning #Verification

Issue Date: 2025-08-13 [Paper Note] Can Language Models Falsify? Evaluating Algorithmic Reasoning with Counterexample Creation, Shiven Sinha+, arXiv'25 Summary言語モデル(LM)の科学的発見を加速するために、微妙に誤った解決策に対する反例を作成する能力を評価する新しいベンチマーク「REFUTE」を提案。これはプログラミング問題からの誤った提出物を用いており、最も優れた推論エージェントでも9%未満の反例しか生成できないことが示された。この研究は、LMの誤った解決策を否定する能力を向上させ、信頼できる推論を通じて自己改善を促進することを目指している。 Commentpj page:https://falsifiers.github.io元ポスト:https://x.com/shashwatgoel7/status/1955311868915966173?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Qバグのあるコードとtask descriptionが与えられた時に、inputのフォーマットと全ての制約を満たすが、コードの実行が失敗するサンプル(=反例)を生成することで、モデルのreasoning capabilityの評価をするベンチマーク。

gpt-ossはコードにバグのあるコードに対して上記のような反例を生成する能力が高いようである。ただし、それでも全体のバグのあるコードのうち反例を生成できたのは高々21.6%のようである。ただ、もしコードだけでなくverification全般の能力が高いから、相当使い道がありそう。 #Pocket #NLP #Dataset #LanguageModel #Evaluation #Reasoning

Issue Date: 2025-08-10 [Paper Note] STEPWISE-CODEX-Bench: Evaluating Complex Multi-Function Comprehension and Fine-Grained Execution Reasoning, Kaiwen Yan+, arXiv'25 Summary新しいベンチマーク「STEPWISE-CODEX-Bench(SX-Bench)」を提案し、複雑な多機能理解と細かい実行推論を評価。SX-Benchは、サブ関数間の協力を含むタスクを特徴とし、動的実行の深い理解を測定する。20以上のモデルで評価した結果、最先端モデルでも複雑な推論においてボトルネックが明らかに。SX-Benchはコード評価を進展させ、高度なコードインテリジェンスモデルの評価に貢献する。 Comment元ポスト:https://x.com/gm8xx8/status/1954296753525752266?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q現在の主流なコード生成のベンチは、input/outputがgivenなら上でコードスニペットを生成する形式が主流(e.g., MBPP 2439, HumanEval 2438)だが、モデルがコードを理解し、複雑なコードのロジックを実行する内部状態の変化に応じて、実行のプロセスを推論する能力が見落とされている。これを解決するために、CRUXEVAL 2440, CRUXEVAL-X 2441 では、関数のinputs/outputsを予測することで、モデルのコードのcomprehension, reasoning能力を測ろうとしているが、

・single functionのlogicに限定されている

・20 line程度の短く、trivialなロジックに限定されている

・すでにSoTAモデルで95%が達成され飽和している

というlimitationがあるので、複数の関数が協働するロジック、flow/dataのinteractionのフロー制御、細かい実行ステップなどを含む、staticなコードの理解から、動的な実行プロセスのモデリング能力の評価にシフトするような、新たなベンチマークを作成しました、という話な模様。

まず関数単位のライブラリを構築している。このために、単一の関数の基礎的な仕様を「同じinputに対して同じoutputを返すものは同じクラスにマッピングされる」と定義し、既存のコードリポジトリとLLMによる合成によって、GoとPythonについて合計30種類のクラスと361個のインスタンスを収集。これらの関数は、算術演算や大小比較、パリティチェックなどの判定、文字列の操作などを含む。そしてこれら関数を3種類の実行パターンでオーケストレーションすることで、合成関数を作成した。合成方法は

・Sequential: outputとinputをパイプラインでつなぎ伝搬させる

・Selective: 条件に応じてf(x)が実行されるか、g(x)が実行されるかを制御

・Loop: input集合に対するloopの中に関数を埋め込み順次関数を実行

の3種類。合成関数の挙動を評価するために、ランダムなテストケースは自動生成し、合成関数の挙動をモニタリング(オーバーフロー、無限ループ、タイムアウト、複数回の実行でoutputが決定的か等など)し、異常があるものはフィルタリングすることで合成関数の品質を担保する。

ベンチマーキングの方法としては、CRUXEVALではシンプルにモデルにコードの実行結果を予想させるだけであったが、指示追従能力の問題からミスジャッジをすることがあるため、この問題に対処するため<input, output>のペアが与えられた時に、outputが合成関数に対してinputしま結果とマッチするかをyes/noのbinaryで判定させる(Predictと呼ばれるモデルのコード理解力を評価)。これとは別に、与えられたinput, outputペアと合成関数に基づいて、実行時の合計のcomputation stepsを出力させるタスクをreasoningタスクとして定義し、複雑度に応じてeasy, hardに分類している。computation stepsは、プログラムを実行する最小単位のことであり、たとえば算術演算などの基礎的なarithmetic/logic operationを指す。

Issue Date: 2025-08-19 [Paper Note] AutoCodeBench: Large Language Models are Automatic Code Benchmark Generators, Jason Chou+, arXiv'25 SummaryAutoCodeGenを提案し、手動注釈なしで高難易度の多言語コード生成データセットを自動生成。これに基づき、3,920の問題からなるAutoCodeBenchを導入し、20のプログラミング言語に均等に分配。30以上のLLMsを評価した結果、最先端のモデルでも多様性や複雑さに苦労していることが明らかに。AutoCodeBenchシリーズは、実用的な多言語コード生成シナリオに焦点を当てるための貴重なリソースとなることを期待。 Commentpj page:https://autocodebench.github.io/元ポスト:https://x.com/tencenthunyuan/status/1957751900608110982?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Pocket #NLP #Dataset #LanguageModel #Evaluation #Reasoning #Verification

Issue Date: 2025-08-13 [Paper Note] Can Language Models Falsify? Evaluating Algorithmic Reasoning with Counterexample Creation, Shiven Sinha+, arXiv'25 Summary言語モデル(LM)の科学的発見を加速するために、微妙に誤った解決策に対する反例を作成する能力を評価する新しいベンチマーク「REFUTE」を提案。これはプログラミング問題からの誤った提出物を用いており、最も優れた推論エージェントでも9%未満の反例しか生成できないことが示された。この研究は、LMの誤った解決策を否定する能力を向上させ、信頼できる推論を通じて自己改善を促進することを目指している。 Commentpj page:https://falsifiers.github.io元ポスト:https://x.com/shashwatgoel7/status/1955311868915966173?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Qバグのあるコードとtask descriptionが与えられた時に、inputのフォーマットと全ての制約を満たすが、コードの実行が失敗するサンプル(=反例)を生成することで、モデルのreasoning capabilityの評価をするベンチマーク。

gpt-ossはコードにバグのあるコードに対して上記のような反例を生成する能力が高いようである。ただし、それでも全体のバグのあるコードのうち反例を生成できたのは高々21.6%のようである。ただ、もしコードだけでなくverification全般の能力が高いから、相当使い道がありそう。 #Pocket #NLP #Dataset #LanguageModel #Evaluation #Reasoning

Issue Date: 2025-08-10 [Paper Note] STEPWISE-CODEX-Bench: Evaluating Complex Multi-Function Comprehension and Fine-Grained Execution Reasoning, Kaiwen Yan+, arXiv'25 Summary新しいベンチマーク「STEPWISE-CODEX-Bench(SX-Bench)」を提案し、複雑な多機能理解と細かい実行推論を評価。SX-Benchは、サブ関数間の協力を含むタスクを特徴とし、動的実行の深い理解を測定する。20以上のモデルで評価した結果、最先端モデルでも複雑な推論においてボトルネックが明らかに。SX-Benchはコード評価を進展させ、高度なコードインテリジェンスモデルの評価に貢献する。 Comment元ポスト:https://x.com/gm8xx8/status/1954296753525752266?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q現在の主流なコード生成のベンチは、input/outputがgivenなら上でコードスニペットを生成する形式が主流(e.g., MBPP 2439, HumanEval 2438)だが、モデルがコードを理解し、複雑なコードのロジックを実行する内部状態の変化に応じて、実行のプロセスを推論する能力が見落とされている。これを解決するために、CRUXEVAL 2440, CRUXEVAL-X 2441 では、関数のinputs/outputsを予測することで、モデルのコードのcomprehension, reasoning能力を測ろうとしているが、

・single functionのlogicに限定されている

・20 line程度の短く、trivialなロジックに限定されている

・すでにSoTAモデルで95%が達成され飽和している

というlimitationがあるので、複数の関数が協働するロジック、flow/dataのinteractionのフロー制御、細かい実行ステップなどを含む、staticなコードの理解から、動的な実行プロセスのモデリング能力の評価にシフトするような、新たなベンチマークを作成しました、という話な模様。

まず関数単位のライブラリを構築している。このために、単一の関数の基礎的な仕様を「同じinputに対して同じoutputを返すものは同じクラスにマッピングされる」と定義し、既存のコードリポジトリとLLMによる合成によって、GoとPythonについて合計30種類のクラスと361個のインスタンスを収集。これらの関数は、算術演算や大小比較、パリティチェックなどの判定、文字列の操作などを含む。そしてこれら関数を3種類の実行パターンでオーケストレーションすることで、合成関数を作成した。合成方法は

・Sequential: outputとinputをパイプラインでつなぎ伝搬させる

・Selective: 条件に応じてf(x)が実行されるか、g(x)が実行されるかを制御

・Loop: input集合に対するloopの中に関数を埋め込み順次関数を実行

の3種類。合成関数の挙動を評価するために、ランダムなテストケースは自動生成し、合成関数の挙動をモニタリング(オーバーフロー、無限ループ、タイムアウト、複数回の実行でoutputが決定的か等など)し、異常があるものはフィルタリングすることで合成関数の品質を担保する。

ベンチマーキングの方法としては、CRUXEVALではシンプルにモデルにコードの実行結果を予想させるだけであったが、指示追従能力の問題からミスジャッジをすることがあるため、この問題に対処するため<input, output>のペアが与えられた時に、outputが合成関数に対してinputしま結果とマッチするかをyes/noのbinaryで判定させる(Predictと呼ばれるモデルのコード理解力を評価)。これとは別に、与えられたinput, outputペアと合成関数に基づいて、実行時の合計のcomputation stepsを出力させるタスクをreasoningタスクとして定義し、複雑度に応じてeasy, hardに分類している。computation stepsは、プログラムを実行する最小単位のことであり、たとえば算術演算などの基礎的なarithmetic/logic operationを指す。

#Pretraining

#Pocket

#NLP

#Dataset

#LanguageModel

#SyntheticData

#Mathematics

#mid-training

#COLM

Issue Date: 2025-07-10

[Paper Note] MegaMath: Pushing the Limits of Open Math Corpora, Fan Zhou+, COLM'25

SummaryMegaMathは、数学に特化したオープンデータセットで、LLMの数学的推論能力を向上させるために作成された。ウェブデータの再抽出、数学関連コードの特定、合成データの生成を通じて、371Bトークンの高品質なデータを提供し、既存のデータセットを上回る量と品質を実現した。

Comment元ポスト:https://x.com/fazhou_998/status/1942610771915202590?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q非常に大規模な数学の事前学習/mid-training向けのデータセット

CommonCrawlのHTMLから、さまざまなフィルタリング処理(reformatting, 2 stageのHTML parserの活用(片方はnoisyだが高速、もう一方は高性能だが遅い), fasttextベースの分類器による抽出, deduplication等)を実施しMegaMath-Webを作成、また、MegaMathWebをさらに分類器で低品質なものをフィルタリングし、LLMによってノイズ除去、テキストのreorganizingを実施し(≠ピュアな合成データ)継続事前学習、mid-training向けの高品質なMegaMath-Web-Proを作成。

MegaMathCodeはThe Stack V2 (2199) をベースにしており、mathematical reasoning, logic puzzles, scientific computationに関するコードを収集。まずこれらのコードと関連が深い11のプログラミング言語を選定し、そのコードスニペットのみを対象とする。次にstrong LLMを用いて、数学に関するrelevanceスコアと、コードの品質を0--6のdiscrete scoreでスコアリングし学習データを作成。作成した学習データでSLMを学習し大規模なフィルタリングを実施することでMegaMath-Codeを作成。

最後にMegaMath-{Web, code}を用いて、Q&A, code data, text&code block dataの3種類を合成。Q&Aデータの合成では、MegaMath-WebからQAペアを抽出し、多様性とデータ量を担保するためQwen2.5-72B-Instruct, Llama3.3-70B-Instructの両方を用いて、QAのsolutionを洗練させる(reasoning stepの改善, あるいはゼロから生成する[^1])ことで生成。また、code dataでは、pythonを対象にMegaMath-Codeのデータに含まれるpython以外のコードを、Qwen2.5-Coder-32B-Instructと、Llamd3.1-70B-Instructによってpythonに翻訳することでデータ量を増やした。text&code blockデータでは、MegaMath-Webのドキュメントを与えて、ブロックを生成(タイトル、数式、結果、コードなど[^1])し、ブロックのverificationを行い(コードが正しく実行できるか、実行結果とanswerが一致するか等)、verifiedなブロックを残すことで生成。

[^1]: この辺は論文の記述を咀嚼して記述しており実サンプルを見ていないので少し正しい認識か不安 #Pocket #NLP #Dataset #LanguageModel #Evaluation Issue Date: 2025-06-17 [Paper Note] LiveCodeBench Pro: How Do Olympiad Medalists Judge LLMs in Competitive Programming?, Zihan Zheng+, arXiv'25 Summary大規模言語モデル(LLMs)は競技プログラミングで人間のエリートを上回るとされるが、実際には重要な限界があることを調査。新たに導入した「LiveCodeBench Pro」ベンチマークにより、LLMsは中程度の難易度の問題で53%のpass@1を達成する一方、難しい問題では0%という結果が得られた。LLMsは実装重視の問題では成功するが、複雑なアルゴリズム的推論には苦労し、誤った正当化を生成することが多い。これにより、LLMsと人間の専門家との間に重要なギャップがあることが明らかになり、今後の改善のための診断が提供される。 Comment元ポスト:https://x.com/arankomatsuzaki/status/1934433210387296414?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-QHardな問題は現状のSoTAモデル(Claude4が含まれていないが)でも正答率0.0%

ベンチマークに含まれる課題のカテゴリ

実サンプルやケーススタディなどはAppendix参照のこと。 #Pocket #NLP #Dataset #LLMAgent #Evaluation #LongSequence Issue Date: 2025-06-17 [Paper Note] ALE-Bench: A Benchmark for Long-Horizon Objective-Driven Algorithm Engineering, Yuki Imajuku+, arXiv'25 SummaryAIシステムの最適化問題に対するパフォーマンスを評価する新しいベンチマークALE-Benchを提案。ALE-Benchは実際のタスクに基づき、長期的な解決策の洗練を促進する。大規模言語モデル(LLM)の評価では特定の問題で高いパフォーマンスを示すが、一貫性や長期的な問題解決能力において人間とのギャップが残ることが明らかになり、今後のAI進展に向けた必要性を示唆している。 Comment元ポスト:https://x.com/sakanaailabs/status/1934767254715117812?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q関連ポスト:https://x.com/iwiwi/status/1934830621756674499?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Pocket #NLP #LanguageModel #ReinforcementLearning #SoftwareEngineering #UnitTest Issue Date: 2025-06-05 [Paper Note] Co-Evolving LLM Coder and Unit Tester via Reinforcement Learning, Yinjie Wang+, arXiv'25 SummaryCUREは、コーディングとユニットテスト生成を共進化させる強化学習フレームワークで、真のコードを監視せずにトレーニングを行う。ReasonFlux-Coderモデルは、コード生成精度を向上させ、下流タスクにも効果的に拡張可能。ユニットテスト生成では高い推論効率を達成し、強化学習のための効果的な報酬モデルとして機能する。 Comment元ポスト:https://x.com/lingyang_pu/status/1930234983274234232?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-QUnitTestの性能向上させます系の研究が増えてきている感関連ポスト:https://x.com/gm8xx8/status/1930348014146859345?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Pocket #NLP #Dataset #LanguageModel #Evaluation #Reasoning #MultiLingual Issue Date: 2025-08-15 [Paper Note] CRUXEval-X: A Benchmark for Multilingual Code Reasoning, Understanding and Execution, Ruiyang Xu+, arXiv'24 SummaryCRUXEVAL-Xという多言語コード推論ベンチマークを提案。19のプログラミング言語を対象に、各言語で600以上の課題を含む19Kのテストを自動生成。言語間の相関を評価し、Python訓練モデルが他言語でも高い性能を示すことを確認。 Comment関連:

・2440 #Pocket #NLP #Dataset #LanguageModel #Evaluation #Reasoning Issue Date: 2025-08-15 [Paper Note] CRUXEval: A Benchmark for Code Reasoning, Understanding and Execution, Alex Gu+, arXiv'24 SummaryCRUXEvalという800のPython関数からなるベンチマークを提案し、入力予測と出力予測の2つのタスクを評価。20のコードモデルをテストした結果、HumanEvalで高得点のモデルがCRUXEvalでは改善を示さないことが判明。GPT-4とChain of Thoughtを用いた場合、入力予測で75%、出力予測で81%のpass@1を達成したが、どのモデルも完全にはクリアできず、GPT-4のコード推論能力の限界を示す例を提供。 #Pretraining #Pocket #NLP #Dataset #LanguageModel Issue Date: 2025-07-13 [Paper Note] StarCoder 2 and The Stack v2: The Next Generation, Anton Lozhkov+, arXiv'24 SummaryBigCodeプロジェクトは、責任あるCode LLMsの開発に焦点を当て、StarCoder2を発表。Software Heritageと提携し、The Stack v2を構築し、619のプログラミング言語を含む大規模なトレーニングセットを作成。StarCoder2モデルは3B、7B、15Bのパラメータを持ち、徹底的なベンチマーク評価で優れた性能を示す。特にStarCoder2-15Bは、同等の他モデルを大幅に上回り、数学やコード推論でも高い性能を発揮。モデルの重みはOpenRAILライセンスで公開され、トレーニングデータの透明性も確保。 Comment関連:

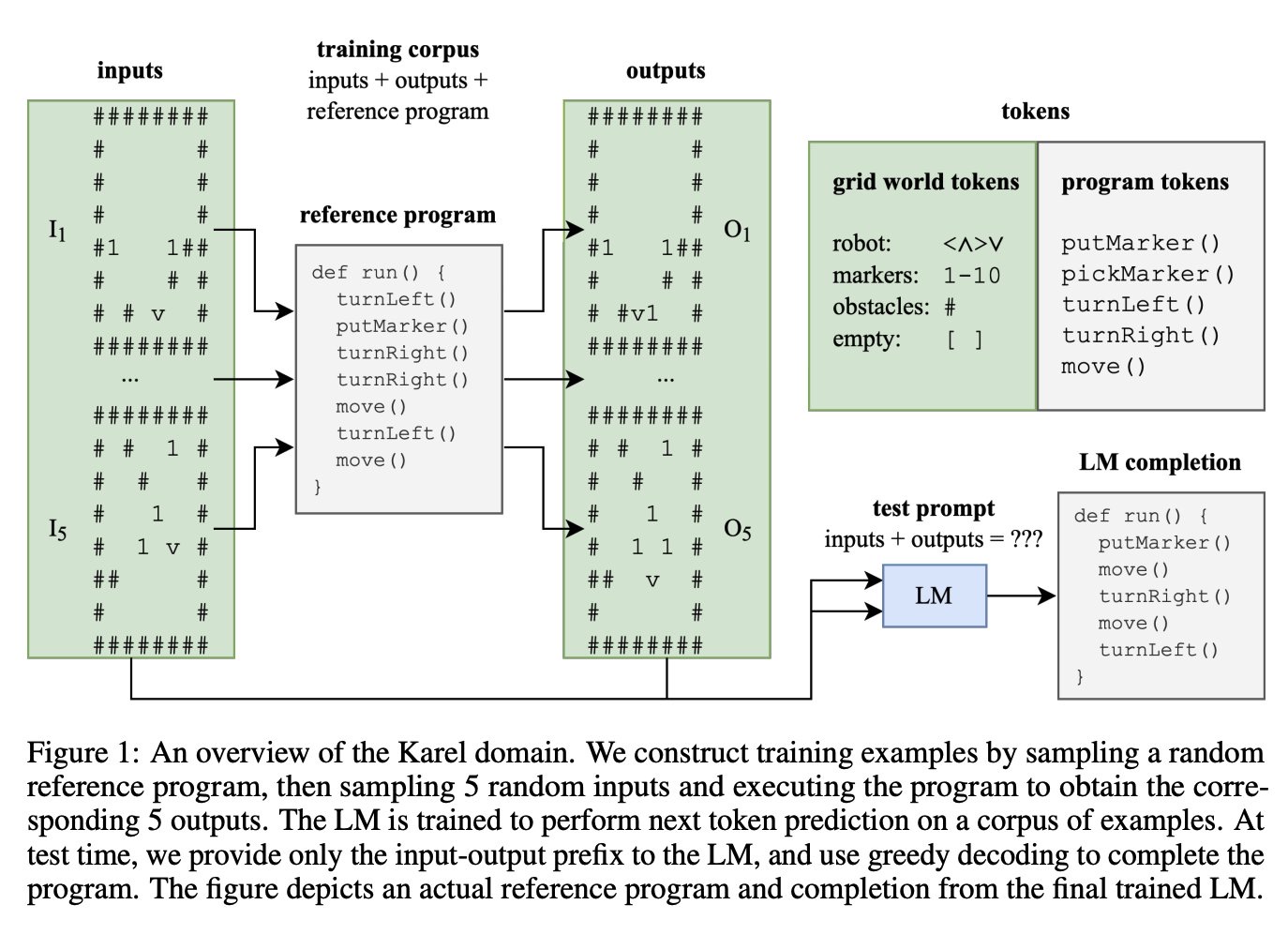

・661 #Pocket #NLP #Dataset #LanguageModel Issue Date: 2023-07-18 Socratic Questioning of Novice Debuggers: A Benchmark Dataset and Preliminary Evaluations, ACL-BEA'23 Summary本研究では、初心者プログラマがバグのある計算問題を解決する際に、ソクラテス的な対話を行うデータセットを紹介し、GPTベースの言語モデルのデバッグ能力を評価しました。GPT-4はGPT-3.5よりも優れたパフォーマンスを示しましたが、まだ人間の専門家には及ばず、さらなる研究が必要です。 #Analysis #Pocket #NLP #LanguageModel Issue Date: 2023-05-20 Evidence of Meaning in Language Models Trained on Programs, Charles Jin+, N_A, arXiv'23 Summary本研究では、プログラムのコーパスを用いて言語モデルが意味を学習できることを示し、プログラム合成が言語モデルの意味の存在を特徴づけるための中間テストベッドとして適していることを述べている。Transformerモデルを用いた実験により、言語の意味を学習するための帰納バイアスを提供しないにもかかわらず、線形プローブがモデルの状態から現在および将来のプログラム状態の抽象化を抽出できることがわかった。また、正しいプログラムを生成することを学習し、平均的に訓練セットよりも短いプログラムを生成することも示した。本論文は、言語モデルの訓練に新しい技術を提案するものではなく、(形式的な)意味の習得と表現に関する実験的なフレームワークを開発し、洞察を提供する。 CommentプログラムのコーパスでLLMをNext Token Predictionで訓練し

厳密に正解とsemanticsを定義した上で、訓練データと異なるsemanticsの異なるプログラムを生成できることを示した。

LLMが意味を理解していることを暗示している

#Article

#NLP

#LanguageModel

#Evaluation

#Reasoning

Issue Date: 2025-08-21

Aider LLM Leaderboards, 2024.12

Comment最近よく見かけるいわゆるAider Polyglot。人間の介入なしに、LLMがコードの"編集"をする能力を測るベンチマーク。性能だけでなくコストもリーダーボードに記載されている。C++,Go,Java,JavaScript,Python,RustによるExercimにおける225の"最も困難な"エクササイズのみが含まれる。データセット:https://github.com/Aider-AI/polyglot-benchmark

#Article

#NLP

#LanguageModel

#LLMAgent

#Repository

Issue Date: 2025-08-19

DeepCode, Data Intelligence Lab@HKU, 2025.08

Comment研究論文からコードを生成するpaper2code、テキストからweb pageを生成するtext2web、textからスケーラブルなバックエンドを構築するtext2backendを現状サポートしているvibe coding frameworkらしい。

#Article

#NLP

#LanguageModel

#Evaluation

#Reasoning

Issue Date: 2025-08-21

Aider LLM Leaderboards, 2024.12

Comment最近よく見かけるいわゆるAider Polyglot。人間の介入なしに、LLMがコードの"編集"をする能力を測るベンチマーク。性能だけでなくコストもリーダーボードに記載されている。C++,Go,Java,JavaScript,Python,RustによるExercimにおける225の"最も困難な"エクササイズのみが含まれる。データセット:https://github.com/Aider-AI/polyglot-benchmark

#Article

#NLP

#LanguageModel

#LLMAgent

#Repository

Issue Date: 2025-08-19

DeepCode, Data Intelligence Lab@HKU, 2025.08

Comment研究論文からコードを生成するpaper2code、テキストからweb pageを生成するtext2web、textからスケーラブルなバックエンドを構築するtext2backendを現状サポートしているvibe coding frameworkらしい。

論文のベンチマークの再現の自動化やパフォーマンス向上、自動コード検証などが追加されるらしい。研究の出版に対して再現実験など現状到底間に合わないので、再現性があるかどうかを自動的に検証して欲しいなぁ、とは思っていたので個人的に嬉しい。 #Article #Tools #NLP #LanguageModel #LLMAgent #Blog #ProprietaryLLM Issue Date: 2025-08-06 Claude Opus 4.1, Anthropic, 2025.08 Comment他モデルとの性能比較:

やはりコーディングでは(SNS上での口コミでは非常に高評価なように見えており、かつ)o3やGeminiと比較してClaudeがベンチ上でも高い性能を示している模様。元ポスト:https://x.com/anthropicai/status/1952768432027431127?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Article #NLP #LanguageModel #OpenWeight Issue Date: 2025-08-03 XBai-o4, MetaStoneAI, 2025.08 Comment元ポスト:https://x.com/kimmonismus/status/1951622895727427697?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-QLiveCodeBenchでo3-mini-2015-01-31(medium)と同等らしい #Article #EfficiencyImprovement #NLP #LanguageModel #Reasoning #MoE(Mixture-of-Experts) Issue Date: 2025-08-02 Qwen3-Coder-30B-A3B-Instruct, QwenTeam, 2025.08 Comment元ポスト:https://x.com/alibaba_qwen/status/1950925444057792808?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Article

#LLMAgent

#Slide

#SoftwareEngineering

#Sequrity

Issue Date: 2025-07-26

運用して初めてわかったDevinのセキュリティ課題 - Devin Meetup Tokyo 2025, 株式会社メルカリHiroki Akamatsu, 2025.07

#Article

#LLMAgent

#project_template

#SoftwareEngineering

Issue Date: 2025-07-26

Python Template for Claude Code (Cookiecutter), zerebom, 2025.07

Comment元ポスト:https://x.com/zerebom_3/status/1949050050694582703?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q

#Article

#NLP

#LLMAgent

#Slide

Issue Date: 2025-07-25

AI時代のソフトウェア開発を考える(2025_07版) _ Agentic Software Engineering Findy 2025-07 Edition, Takuto Wada, 2025.07

CommentVibe Codingによってソフトウェアエンジニアリングの課題は解決されたわけではなく、昔からある問題は依然として存在し(技術的負債、レビューなど)、道具が変わりこれらが顕在化するスピードが急速に速まっただけ、という話な模様。

#Article

#LLMAgent

#Slide

#SoftwareEngineering

#Sequrity

Issue Date: 2025-07-26

運用して初めてわかったDevinのセキュリティ課題 - Devin Meetup Tokyo 2025, 株式会社メルカリHiroki Akamatsu, 2025.07

#Article

#LLMAgent

#project_template

#SoftwareEngineering

Issue Date: 2025-07-26

Python Template for Claude Code (Cookiecutter), zerebom, 2025.07

Comment元ポスト:https://x.com/zerebom_3/status/1949050050694582703?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q

#Article

#NLP

#LLMAgent

#Slide

Issue Date: 2025-07-25

AI時代のソフトウェア開発を考える(2025_07版) _ Agentic Software Engineering Findy 2025-07 Edition, Takuto Wada, 2025.07

CommentVibe Codingによってソフトウェアエンジニアリングの課題は解決されたわけではなく、昔からある問題は依然として存在し(技術的負債、レビューなど)、道具が変わりこれらが顕在化するスピードが急速に速まっただけ、という話な模様。

どの領域に、どのAIを使うか(委託, 伴走)なども考察されている。ロジックの複雑さが小さいものは委託(補完など)、ロジックの複雑さが高く競合との差別化が重要なエリアには伴走、といった使い方。AIは自走するが迷走、暴走もするのでガードレールがより一層重要。自分自身の能力の向上も不可欠。 #Article #LanguageModel #SoftwareEngineering Issue Date: 2025-07-25 anycoder, akhaliq, 2025.07 Commentこんなことができる模様。サイトのリニューアルに使ってみようかしら、、、

https://x.com/sivil_taram/status/1948030614076342632?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Article #NLP #LanguageModel #LLMAgent #Repository Issue Date: 2025-07-23 Qwen Code, Qwen Team, 2025.07 #Article #Tutorial #LanguageModel #SoftwareEngineering #MCP Issue Date: 2025-07-14 advanced-mcp-features, epicweb-dev, 2025.06 CommentMCPの勉強に良いかもしれないのでメモ #Article #LLMAgent #Slide #SoftwareEngineering #ContextEngineering Issue Date: 2025-07-06 Claude Code の Context Engineering, schroneko, 2025.07 #Article #NLP #LLMAgent #Blog #SoftwareEngineering Issue Date: 2025-06-23 AI Agent Manager (AAM) として生きていく : 作業環境とワークフローの設計, icoxfog417, 2025.06 Comment元ポスト:https://x.com/icoxfog417/status/1936929479324319807?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Article #LLMAgent #Blog #read-later Issue Date: 2025-06-21 AI-assisted coding for teams that can't get away with vibes, Atharva Raykar, 2025.05 Comment元ポスト:https://x.com/deedydas/status/1936090859319259321?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Article #NaturalLanguageGeneration #NLP #LanguageModel #FoundationModel #Blog Issue Date: 2023-05-06 StarCoderBase_StarCoder, 2023 Comment・15.5Bパラメータ

・80種類以上のプログラミング言語で訓練

・Multi Query Attentionを利用

・context window size 8192

・Fill in the middle objectiveを利用

Instruction tuningがされておらず、prefixとsuffixの間を埋めるような訓練のされ方をしているので、たとえば関数名をinputして、そのmiddle(関数の中身)を出力させる、といった使い方になる模様。paper: https://drive.google.com/file/d/1cN-b9GnWtHzQRoE7M7gAEyivY0kl4BYs/viewStarCoder:

https://huggingface.co/bigcode/starcoderStarCoderBaseを35Bのpython tokenでfinetuningしたモデル。

既存モデルよりも高性能と主張

#Article

#Tools

#GenerativeAI

#Blog

Issue Date: 2023-01-21

CodeGPT: The VSCode Extension with ChatGPT-Like Functionalities

CommentVSCodeの拡張で、//から始まるPromptをエディタ上で記載することで対応するコードをGPT3が生成してくれる模様。便利そう

#Article

#Tutorial

#Pocket

#Slide

Issue Date: 2022-03-02

良いコードとは何か - エンジニア新卒研修 スライド公開, CyberZ, 森

#Article

#Tutorial

#Blog

Issue Date: 2021-11-25

Pythonのオブジェクト指向プログラミングを完全理解, kaitolucifer (Kaito), 2021

Commentオブジェクト指向の歴史的背景から、SOLID、GRASP等が詳細に解説されている。辞書的に参照するのが良いかも。

#Article

#Tutorial

#Blog

Issue Date: 2021-11-25

イラストで理解するSOLID原則, baby-degu, 2021

Commentオブジェクト指向におけるSOLID原則をイラストで解説した記事。直感的で分かりやすい。

#Article

#Tools

#GenerativeAI

#Blog

Issue Date: 2023-01-21

CodeGPT: The VSCode Extension with ChatGPT-Like Functionalities

CommentVSCodeの拡張で、//から始まるPromptをエディタ上で記載することで対応するコードをGPT3が生成してくれる模様。便利そう

#Article

#Tutorial

#Pocket

#Slide

Issue Date: 2022-03-02

良いコードとは何か - エンジニア新卒研修 スライド公開, CyberZ, 森

#Article

#Tutorial

#Blog

Issue Date: 2021-11-25

Pythonのオブジェクト指向プログラミングを完全理解, kaitolucifer (Kaito), 2021

Commentオブジェクト指向の歴史的背景から、SOLID、GRASP等が詳細に解説されている。辞書的に参照するのが良いかも。

#Article

#Tutorial

#Blog

Issue Date: 2021-11-25

イラストで理解するSOLID原則, baby-degu, 2021

Commentオブジェクト指向におけるSOLID原則をイラストで解説した記事。直感的で分かりやすい。

CommonCrawlのHTMLから、さまざまなフィルタリング処理(reformatting, 2 stageのHTML parserの活用(片方はnoisyだが高速、もう一方は高性能だが遅い), fasttextベースの分類器による抽出, deduplication等)を実施しMegaMath-Webを作成、また、MegaMathWebをさらに分類器で低品質なものをフィルタリングし、LLMによってノイズ除去、テキストのreorganizingを実施し(≠ピュアな合成データ)継続事前学習、mid-training向けの高品質なMegaMath-Web-Proを作成。

MegaMathCodeはThe Stack V2 (2199) をベースにしており、mathematical reasoning, logic puzzles, scientific computationに関するコードを収集。まずこれらのコードと関連が深い11のプログラミング言語を選定し、そのコードスニペットのみを対象とする。次にstrong LLMを用いて、数学に関するrelevanceスコアと、コードの品質を0--6のdiscrete scoreでスコアリングし学習データを作成。作成した学習データでSLMを学習し大規模なフィルタリングを実施することでMegaMath-Codeを作成。

最後にMegaMath-{Web, code}を用いて、Q&A, code data, text&code block dataの3種類を合成。Q&Aデータの合成では、MegaMath-WebからQAペアを抽出し、多様性とデータ量を担保するためQwen2.5-72B-Instruct, Llama3.3-70B-Instructの両方を用いて、QAのsolutionを洗練させる(reasoning stepの改善, あるいはゼロから生成する[^1])ことで生成。また、code dataでは、pythonを対象にMegaMath-Codeのデータに含まれるpython以外のコードを、Qwen2.5-Coder-32B-Instructと、Llamd3.1-70B-Instructによってpythonに翻訳することでデータ量を増やした。text&code blockデータでは、MegaMath-Webのドキュメントを与えて、ブロックを生成(タイトル、数式、結果、コードなど[^1])し、ブロックのverificationを行い(コードが正しく実行できるか、実行結果とanswerが一致するか等)、verifiedなブロックを残すことで生成。

[^1]: この辺は論文の記述を咀嚼して記述しており実サンプルを見ていないので少し正しい認識か不安 #Pocket #NLP #Dataset #LanguageModel #Evaluation Issue Date: 2025-06-17 [Paper Note] LiveCodeBench Pro: How Do Olympiad Medalists Judge LLMs in Competitive Programming?, Zihan Zheng+, arXiv'25 Summary大規模言語モデル(LLMs)は競技プログラミングで人間のエリートを上回るとされるが、実際には重要な限界があることを調査。新たに導入した「LiveCodeBench Pro」ベンチマークにより、LLMsは中程度の難易度の問題で53%のpass@1を達成する一方、難しい問題では0%という結果が得られた。LLMsは実装重視の問題では成功するが、複雑なアルゴリズム的推論には苦労し、誤った正当化を生成することが多い。これにより、LLMsと人間の専門家との間に重要なギャップがあることが明らかになり、今後の改善のための診断が提供される。 Comment元ポスト:https://x.com/arankomatsuzaki/status/1934433210387296414?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-QHardな問題は現状のSoTAモデル(Claude4が含まれていないが)でも正答率0.0%

ベンチマークに含まれる課題のカテゴリ

実サンプルやケーススタディなどはAppendix参照のこと。 #Pocket #NLP #Dataset #LLMAgent #Evaluation #LongSequence Issue Date: 2025-06-17 [Paper Note] ALE-Bench: A Benchmark for Long-Horizon Objective-Driven Algorithm Engineering, Yuki Imajuku+, arXiv'25 SummaryAIシステムの最適化問題に対するパフォーマンスを評価する新しいベンチマークALE-Benchを提案。ALE-Benchは実際のタスクに基づき、長期的な解決策の洗練を促進する。大規模言語モデル(LLM)の評価では特定の問題で高いパフォーマンスを示すが、一貫性や長期的な問題解決能力において人間とのギャップが残ることが明らかになり、今後のAI進展に向けた必要性を示唆している。 Comment元ポスト:https://x.com/sakanaailabs/status/1934767254715117812?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q関連ポスト:https://x.com/iwiwi/status/1934830621756674499?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Pocket #NLP #LanguageModel #ReinforcementLearning #SoftwareEngineering #UnitTest Issue Date: 2025-06-05 [Paper Note] Co-Evolving LLM Coder and Unit Tester via Reinforcement Learning, Yinjie Wang+, arXiv'25 SummaryCUREは、コーディングとユニットテスト生成を共進化させる強化学習フレームワークで、真のコードを監視せずにトレーニングを行う。ReasonFlux-Coderモデルは、コード生成精度を向上させ、下流タスクにも効果的に拡張可能。ユニットテスト生成では高い推論効率を達成し、強化学習のための効果的な報酬モデルとして機能する。 Comment元ポスト:https://x.com/lingyang_pu/status/1930234983274234232?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-QUnitTestの性能向上させます系の研究が増えてきている感関連ポスト:https://x.com/gm8xx8/status/1930348014146859345?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Pocket #NLP #Dataset #LanguageModel #Evaluation #Reasoning #MultiLingual Issue Date: 2025-08-15 [Paper Note] CRUXEval-X: A Benchmark for Multilingual Code Reasoning, Understanding and Execution, Ruiyang Xu+, arXiv'24 SummaryCRUXEVAL-Xという多言語コード推論ベンチマークを提案。19のプログラミング言語を対象に、各言語で600以上の課題を含む19Kのテストを自動生成。言語間の相関を評価し、Python訓練モデルが他言語でも高い性能を示すことを確認。 Comment関連:

・2440 #Pocket #NLP #Dataset #LanguageModel #Evaluation #Reasoning Issue Date: 2025-08-15 [Paper Note] CRUXEval: A Benchmark for Code Reasoning, Understanding and Execution, Alex Gu+, arXiv'24 SummaryCRUXEvalという800のPython関数からなるベンチマークを提案し、入力予測と出力予測の2つのタスクを評価。20のコードモデルをテストした結果、HumanEvalで高得点のモデルがCRUXEvalでは改善を示さないことが判明。GPT-4とChain of Thoughtを用いた場合、入力予測で75%、出力予測で81%のpass@1を達成したが、どのモデルも完全にはクリアできず、GPT-4のコード推論能力の限界を示す例を提供。 #Pretraining #Pocket #NLP #Dataset #LanguageModel Issue Date: 2025-07-13 [Paper Note] StarCoder 2 and The Stack v2: The Next Generation, Anton Lozhkov+, arXiv'24 SummaryBigCodeプロジェクトは、責任あるCode LLMsの開発に焦点を当て、StarCoder2を発表。Software Heritageと提携し、The Stack v2を構築し、619のプログラミング言語を含む大規模なトレーニングセットを作成。StarCoder2モデルは3B、7B、15Bのパラメータを持ち、徹底的なベンチマーク評価で優れた性能を示す。特にStarCoder2-15Bは、同等の他モデルを大幅に上回り、数学やコード推論でも高い性能を発揮。モデルの重みはOpenRAILライセンスで公開され、トレーニングデータの透明性も確保。 Comment関連:

・661 #Pocket #NLP #Dataset #LanguageModel Issue Date: 2023-07-18 Socratic Questioning of Novice Debuggers: A Benchmark Dataset and Preliminary Evaluations, ACL-BEA'23 Summary本研究では、初心者プログラマがバグのある計算問題を解決する際に、ソクラテス的な対話を行うデータセットを紹介し、GPTベースの言語モデルのデバッグ能力を評価しました。GPT-4はGPT-3.5よりも優れたパフォーマンスを示しましたが、まだ人間の専門家には及ばず、さらなる研究が必要です。 #Analysis #Pocket #NLP #LanguageModel Issue Date: 2023-05-20 Evidence of Meaning in Language Models Trained on Programs, Charles Jin+, N_A, arXiv'23 Summary本研究では、プログラムのコーパスを用いて言語モデルが意味を学習できることを示し、プログラム合成が言語モデルの意味の存在を特徴づけるための中間テストベッドとして適していることを述べている。Transformerモデルを用いた実験により、言語の意味を学習するための帰納バイアスを提供しないにもかかわらず、線形プローブがモデルの状態から現在および将来のプログラム状態の抽象化を抽出できることがわかった。また、正しいプログラムを生成することを学習し、平均的に訓練セットよりも短いプログラムを生成することも示した。本論文は、言語モデルの訓練に新しい技術を提案するものではなく、(形式的な)意味の習得と表現に関する実験的なフレームワークを開発し、洞察を提供する。 CommentプログラムのコーパスでLLMをNext Token Predictionで訓練し

厳密に正解とsemanticsを定義した上で、訓練データと異なるsemanticsの異なるプログラムを生成できることを示した。

LLMが意味を理解していることを暗示している

論文のベンチマークの再現の自動化やパフォーマンス向上、自動コード検証などが追加されるらしい。研究の出版に対して再現実験など現状到底間に合わないので、再現性があるかどうかを自動的に検証して欲しいなぁ、とは思っていたので個人的に嬉しい。 #Article #Tools #NLP #LanguageModel #LLMAgent #Blog #ProprietaryLLM Issue Date: 2025-08-06 Claude Opus 4.1, Anthropic, 2025.08 Comment他モデルとの性能比較:

やはりコーディングでは(SNS上での口コミでは非常に高評価なように見えており、かつ)o3やGeminiと比較してClaudeがベンチ上でも高い性能を示している模様。元ポスト:https://x.com/anthropicai/status/1952768432027431127?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Article #NLP #LanguageModel #OpenWeight Issue Date: 2025-08-03 XBai-o4, MetaStoneAI, 2025.08 Comment元ポスト:https://x.com/kimmonismus/status/1951622895727427697?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-QLiveCodeBenchでo3-mini-2015-01-31(medium)と同等らしい #Article #EfficiencyImprovement #NLP #LanguageModel #Reasoning #MoE(Mixture-of-Experts) Issue Date: 2025-08-02 Qwen3-Coder-30B-A3B-Instruct, QwenTeam, 2025.08 Comment元ポスト:https://x.com/alibaba_qwen/status/1950925444057792808?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q

どの領域に、どのAIを使うか(委託, 伴走)なども考察されている。ロジックの複雑さが小さいものは委託(補完など)、ロジックの複雑さが高く競合との差別化が重要なエリアには伴走、といった使い方。AIは自走するが迷走、暴走もするのでガードレールがより一層重要。自分自身の能力の向上も不可欠。 #Article #LanguageModel #SoftwareEngineering Issue Date: 2025-07-25 anycoder, akhaliq, 2025.07 Commentこんなことができる模様。サイトのリニューアルに使ってみようかしら、、、

https://x.com/sivil_taram/status/1948030614076342632?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Article #NLP #LanguageModel #LLMAgent #Repository Issue Date: 2025-07-23 Qwen Code, Qwen Team, 2025.07 #Article #Tutorial #LanguageModel #SoftwareEngineering #MCP Issue Date: 2025-07-14 advanced-mcp-features, epicweb-dev, 2025.06 CommentMCPの勉強に良いかもしれないのでメモ #Article #LLMAgent #Slide #SoftwareEngineering #ContextEngineering Issue Date: 2025-07-06 Claude Code の Context Engineering, schroneko, 2025.07 #Article #NLP #LLMAgent #Blog #SoftwareEngineering Issue Date: 2025-06-23 AI Agent Manager (AAM) として生きていく : 作業環境とワークフローの設計, icoxfog417, 2025.06 Comment元ポスト:https://x.com/icoxfog417/status/1936929479324319807?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Article #LLMAgent #Blog #read-later Issue Date: 2025-06-21 AI-assisted coding for teams that can't get away with vibes, Atharva Raykar, 2025.05 Comment元ポスト:https://x.com/deedydas/status/1936090859319259321?s=46&t=Y6UuIHB0Lv0IpmFAjlc2-Q #Article #NaturalLanguageGeneration #NLP #LanguageModel #FoundationModel #Blog Issue Date: 2023-05-06 StarCoderBase_StarCoder, 2023 Comment・15.5Bパラメータ

・80種類以上のプログラミング言語で訓練

・Multi Query Attentionを利用

・context window size 8192

・Fill in the middle objectiveを利用

Instruction tuningがされておらず、prefixとsuffixの間を埋めるような訓練のされ方をしているので、たとえば関数名をinputして、そのmiddle(関数の中身)を出力させる、といった使い方になる模様。paper: https://drive.google.com/file/d/1cN-b9GnWtHzQRoE7M7gAEyivY0kl4BYs/viewStarCoder:

https://huggingface.co/bigcode/starcoderStarCoderBaseを35Bのpython tokenでfinetuningしたモデル。

既存モデルよりも高性能と主張

#Article

#Tools

#GenerativeAI

#Blog

Issue Date: 2023-01-21

CodeGPT: The VSCode Extension with ChatGPT-Like Functionalities

CommentVSCodeの拡張で、//から始まるPromptをエディタ上で記載することで対応するコードをGPT3が生成してくれる模様。便利そう

#Article

#Tutorial

#Pocket

#Slide

Issue Date: 2022-03-02

良いコードとは何か - エンジニア新卒研修 スライド公開, CyberZ, 森

#Article

#Tutorial

#Blog

Issue Date: 2021-11-25

Pythonのオブジェクト指向プログラミングを完全理解, kaitolucifer (Kaito), 2021

Commentオブジェクト指向の歴史的背景から、SOLID、GRASP等が詳細に解説されている。辞書的に参照するのが良いかも。

#Article

#Tutorial

#Blog

Issue Date: 2021-11-25

イラストで理解するSOLID原則, baby-degu, 2021

Commentオブジェクト指向におけるSOLID原則をイラストで解説した記事。直感的で分かりやすい。

#Article

#Tools

#GenerativeAI

#Blog

Issue Date: 2023-01-21

CodeGPT: The VSCode Extension with ChatGPT-Like Functionalities

CommentVSCodeの拡張で、//から始まるPromptをエディタ上で記載することで対応するコードをGPT3が生成してくれる模様。便利そう

#Article

#Tutorial

#Pocket

#Slide

Issue Date: 2022-03-02

良いコードとは何か - エンジニア新卒研修 スライド公開, CyberZ, 森

#Article

#Tutorial

#Blog

Issue Date: 2021-11-25

Pythonのオブジェクト指向プログラミングを完全理解, kaitolucifer (Kaito), 2021

Commentオブジェクト指向の歴史的背景から、SOLID、GRASP等が詳細に解説されている。辞書的に参照するのが良いかも。

#Article

#Tutorial

#Blog

Issue Date: 2021-11-25

イラストで理解するSOLID原則, baby-degu, 2021

Commentオブジェクト指向におけるSOLID原則をイラストで解説した記事。直感的で分かりやすい。