TextToImageGeneration

[Paper Note] MultiBanana: A Challenging Benchmark for Multi-Reference Text-to-Image Generation, Yuta Oshima+, CVPR'26, 2025.11

Paper/Blog Link My Issue

#ComputerVision #Dataset #Evaluation #LLM-as-a-Judge #CVPR #2D (Image) #ImageSynthesis Issue Date: 2026-05-26 GPT Summary- マルチ参照生成モデルは複数の参照画像から新たな文脈で被写体を描画するが、既存のデータセットは単一もしくは少数の参照に偏っているため性能評価に限界がある。本研究では、マルチ参照設定に特化したMultiBananaを提案し、参照数やドメイン不一致、スケール不一致、まれな概念、多言語テキストに関する問題を網羅してモデルの限界を評価する。分析により性能と改善点を明らかにし、公正な比較のための標準化された基盤を提供する。 Comment

元ポスト:

[Paper Note] Qwen-Image-2.0 Technical Report, Bing Zhao+, arXiv'26, 2026.05

Paper/Blog Link My Issue

#ComputerVision #NLP #MultiModal #DiffusionModel #VisionLanguageModel #2D (Image) #Editing #ImageSynthesis Issue Date: 2026-05-14 GPT Summary- Qwen-Image-2.0は、高忠実度の生成と正確な画像編集を統合したオムニ機能を持つ画像生成モデルで、テキスト描写や複雑な構図への対応を強化。Qwen3-VLを条件エンコーダとして利用し、Multimodal Diffusion Transformerで条件と出力を同時にモデリング。最大1,000トークンの指示をサポートし、多言語のテキスト忠実度を向上、フォトリアリスティックな生成を実現。広範な人間評価で従来モデルを上回る性能を示し、実用的な画像生成モデルへの進展を果たす。 Comment

元ポスト:

[Paper Note] LLaDA2.0-Uni: Unifying Multimodal Understanding and Generation with Diffusion Large Language Model, Inclusion AI+, arXiv'26, 2026.04

Paper/Blog Link My Issue

#NLP #Chain-of-Thought #MultiModal #DiffusionModel #Reasoning #MoE(Mixture-of-Experts) #read-later #Selected Papers/Blogs #VisionLanguageModel #Editing #UMM #ImageSynthesis #Initial Impression Notes #Author Thread-Post Issue Date: 2026-04-25 GPT Summary- LLaDA2.0-Uniは、マルチモーダルな理解と生成を統合するための統一型離散拡散大規模言語モデルです。意味論的な離散トークナイザとMoEベースのバックボーン、拡散デコーダを組み合わせ、視覚入力を効率的に処理します。高忠実度の画像生成を実現し、推論効率を最適化する独自の手法を採用。特化型VLMに匹敵する性能を持ち、生成と推論の相互運用性で次世代モデルの可能性を広げます。コードは公開されています。 Comment

元ポスト:

VLM * Diffusionモデル。テキストの生成だけでなく、TextToImage, Image Editingもサポートされているように見える。

公式ポスト:

画像を生成する前にreasoningを実施するように訓練され、UMMなのでtext, patchのrepresentationがシームレスに統合され、画像を伴うテキスト生成がより一貫性を持つ、とのこと。

著者ポスト:

[Paper Note] RationalRewards: Reasoning Rewards Scale Visual Generation Both Training and Test Time, Haozhe Wang+, arXiv'26, 2026.04

Paper/Blog Link My Issue

#Multi #ComputerVision #NLP #Reasoning #OpenWeight #Test-Time Scaling #read-later #Selected Papers/Blogs #RewardModel Issue Date: 2026-04-19 GPT Summary- 報酬モデルは、評価を単一のスコアに縮約するのではなく、明示的で多次元の批評を生成することで、生成物の改善を促進する。本研究では、構造化された合理根拠を用いて報酬を提供し、Generate-Critique-Refineループにより批評をプロンプト修正に変換する方法を示す。また、Preference-Anchored Rationalization(PARROT)を導入し、容易に得られるデータから高品質な合理根拠を回収するフレームワークを提供する。得られたRationalRewardsモデルは、オープンソースの中で最先端の予測精度を達成し、より少ない訓練データで優れた性能を発揮する。批評-修正ループは、既存モデルの潜在能力を引き出し、より良い生成結果を提供する。 Comment

pj page: https://tiger-ai-lab.github.io/RationalRewards/

元ポスト:

[Paper Note] BitDance: Scaling Autoregressive Generative Models with Binary Tokens, Yuang Ai+, arXiv'26, 2026.02

Paper/Blog Link My Issue

#ComputerVision #EfficiencyImprovement #NLP #Transformer #DiffusionModel #Decoding #read-later #2D (Image) #ImageSynthesis Issue Date: 2026-02-17 GPT Summary- BitDanceは、バイナリ視覚トークンを予測する自己回帰型の画像生成モデルであり、高エントロピーのバイナリ潜在変数により最大2^{256}の状態を表現できます。バイナリ拡散ヘッドを採用し、標準の分類を超えたトークン生成を実現。次パッチ拡散技術により、複数トークンを高精度で並列予測し、推論速度を8.7倍向上させます。ImageNet 256x256では最高のFIDスコア1.24を達成し、1024x1024画像生成においては従来モデルと比較して30倍以上の速度向上を実現しています。コードとモデルは公開されています。 Comment

pj page: https://bitdance.csuhan.com/

元ポスト:

[Paper Note] Everything in Its Place: Benchmarking Spatial Intelligence of Text-to-Image Models, Zengbin Wang+, arXiv'26, 2026.01

Paper/Blog Link My Issue

#ComputerVision #NLP #Dataset #Evaluation #DiffusionModel #read-later #Selected Papers/Blogs #SpatialUnderstanding Issue Date: 2026-01-31 GPT Summary- T2Iモデルの空間処理能力を評価する新しいベンチマーク「SpatialGenEval」を提案。1,230の長い情報密度の高いプロンプトを用いて、空間関係の推論が主なボトleneckであることを確認。また、「SpatialT2I」データセットを構築し、ファインチューニングによって現実的な空間効果を向上させるデータ中心のアプローチを強調。 Comment

元ポスト:

[Paper Note] Scaling Text-to-Image Diffusion Transformers with Representation Autoencoders, Shengbang Tong+, arXiv'26, 2026.01

Paper/Blog Link My Issue

#ComputerVision #Pretraining #NLP #DiffusionModel #PostTraining #read-later #Selected Papers/Blogs #2D (Image) #Stability #KeyPoint Notes #ImageSynthesis #Scalability #AutoEncoder #Author Thread-Post Issue Date: 2026-01-24 GPT Summary- RAEsは高次元セマンティック空間での成果を活かし、自由形式のテキストから画像生成にスケール可能かを検証。デコーダーを用いてImageNetを超えたスケールアップを行い、特定ドメインの重要性を発見。スケーリングによりフレームワークが単純化される一方、ノイズスケジューリングは依然重要。また、RAEsは全てのモデルスケールでVAEsを上回り、安定した性能を確保し、生成品質の向上を示した。これにより、多モーダルモデルの新たな可能性を切り開く。 Comment

元ポスト:

この研究はざっくり言うとRAE[^1]がスケールするか否かを調査し、スケールするための条件を調査し、事前学習(GenEval, DPGEvalでVAEと比較して4倍早く収束)、ダウンストリームタスクの双方でVAEベースのtext2imageモデルをoutperformすることを示しており、

スケールさせる際の最初の課題はデコーダにあり、web-scale, syntheticデータをただ増やすだけではfidelityは向上するが特定のドメイン(e.g., text reconstruction)の能力は伸びず、text renderingデータなどの、dataの構成が必要不可欠で、

続いてオリジナルのRAEではアーキテクチャに工夫(decoder入力にノイズを足す、ヘッドをwideにする、その他安定化の工夫)をしていたが、モデル、データがスケールした場合シンプルなアーキテクチャ(次元依存のノイズスケジューリング)のみが必須で他は不要となったという知見が得られており、

RAEでは視覚理解と生成が同じ潜在空間の上で行われることがVAEとは異なる強みで、生成のための学習をしても理解能力が損なわれないことを示し、そして、潜在空間上で(VAEの潜在表現は生成に特化しているが、RAEは視覚理解と生成の双方を扱われており同じ空間上で操作可能なので)LLMが直接test time scalingすることを可能にする、

と言ったことが著者ポストで解説されている。

まだ完璧に理解できていないのでRAEの論文から読みたい、が非常にインパクトの大きな話に見える。

[^1]:encoderをSigLIPなどの強力なvision encoderを用いた上で、デコーダを学習する手法。VAEではCNN等で潜在表現を低次元に圧縮するが、表現力に乏しく結果的に意味的な表現を捉える能力に乏しかったが、より強力な事前学習されたエンコーダと高次元の潜在表現を扱うことでDiffusion Modelで扱う潜在表現を進化させる。

[Paper Note] ThinkGen: Generalized Thinking for Visual Generation, Siyu Jiao+, arXiv'25, 2025.12

Paper/Blog Link My Issue

#ComputerVision #Pretraining #NLP #LanguageModel #ReinforcementLearning #Chain-of-Thought #MultiModal #DiffusionModel #PostTraining #read-later #One-Line Notes #ImageSynthesis Issue Date: 2026-01-06 GPT Summary- ThinkGenは、マルチモーダル大規模言語モデル(MLLM)のChain-of-Thought(CoT)推論を活用した初の思考駆動型視覚生成フレームワークである。MLLMが特化した指示を生成し、Diffusion Transformer(DiT)がそれに基づいて高品質な画像を生成する。さらに、MLLMとDiT間で強化学習を行うSepGRPOトレーニングパラダイムを提案し、多様なデータセットに対応した共同トレーニングを可能にする。実験により、ThinkGenは複数の生成ベンチマークで最先端の性能を達成した。 Comment

元ポスト:

MLLMとDiTを別々にRLして、MLLMはDiTが好むplan/instructionを生成し、その後DiTとConnectorに対してplan/instructionに従うようなRLをするような手法のようである。図2,3,4を見ると概要がわかる。

[Paper Note] MMGR: Multi-Modal Generative Reasoning, Zefan Cai+, arXiv'25, 2025.12

Paper/Blog Link My Issue

#ComputerVision #NLP #Dataset #Evaluation #FoundationModel #2D (Image) #3D (Scene) #WorldModels #KeyPoint Notes #TextToVideoGeneration Issue Date: 2025-12-19 GPT Summary- MMGR(Multi-Modal Generative Reasoning Evaluation and Benchmark)を導入し、物理的、論理的、空間的、時間的な推論能力に基づくビデオ基盤モデルの評価フレームワークを提案。既存の指標では見落とされる因果関係や物理法則の違反を考慮し、主要なビデオおよび画像モデルをベンチマークした結果、抽象的推論でのパフォーマンスが低いことが明らかに。MMGRは、生成的世界モデルの推論能力向上に向けた統一診断ベンチマークを提供。 Comment

pj page: https://zefan-cai.github.io/MMGR.github.io/

元ポスト:

video/image 生成モデルを(単なる動画生成という枠ではなく世界モデルという観点で評価するために)

- physical reasoning: ロボットのシミュレーションやinteractionに必要な物理世界の理解力

- logical (abstract) reasoning: System2 Thinkingい必要な抽象的なコンテプトやルールに従う能力(Aが起きたらBが続く)

- 3D spatial reasoning: 世界の認知mapを内包するために必要な3D空間における関係性や、環境の案内、物事の構造や全体像を把握する能力

- 2D spatial reasoning: 複雑なpromptをgroundingするために必要な2D空間に写像されたレイアウト、形状、相対位置を理解する能力

- Temporal Reasoning: coherenceを保つために必要な、因果関係、イベントの順序、長期的な依存関係を捉える能力

の5つの軸で評価するフレームワーク。

[Paper Note] Diffusion Transformers with Representation Autoencoders, Boyang Zheng+, arXiv'25, 2025.10

Paper/Blog Link My Issue

#ComputerVision #Transformer #DiffusionModel #Selected Papers/Blogs #2D (Image) #reading #One-Line Notes #ImageSynthesis #AutoEncoder Issue Date: 2025-12-17 GPT Summary- 本研究では、従来のVAEエンコーダを事前学習された表現エンコーダに置き換えた表現オートエンコーダ(RAE)を提案し、生成モデルの品質向上を目指す。RAEは高品質な再構成と意味的に豊かな潜在空間を提供し、拡散トランスフォーマーの効果的な機能を可能にする。実験により、ImageNetで優れた画像生成結果を達成し、RAEが拡散トランスフォーマーの新しいデフォルトとなるべきことを示した。 Comment

openreview: https://openreview.net/forum?id=0u1LigJaab

pj page: https://rae-dit.github.io

encoderをSigLIPなどの強力な(frozenした)vision encoderを用いた上で、デコーダを学習する手法。VAEではCNN等で潜在表現を低次元に圧縮するが、表現力に乏しく結果的に意味的な表現を捉える能力に乏しかったが、より強力な事前学習されたエンコーダと高次元の潜在表現を扱うことでDiffusion Modelで扱う潜在表現を進化させる。

[Paper Note] SVG-T2I: Scaling Up Text-to-Image Latent Diffusion Model Without Variational Autoencoder, Minglei Shi+, arXiv'25, 2025.12

Paper/Blog Link My Issue

#ComputerVision #DiffusionModel #Self-SupervisedLearning #FlowMatching #reading Issue Date: 2025-12-17 GPT Summary- 視覚生成のためにSVG-T2Iフレームワークを提案し、VFM特徴ドメイン内で高品質なテキストから画像への合成を実現。標準的な拡散パイプラインを用いて競争力のある性能を達成し、GenEvalで0.75、DPG-Benchで85.78を記録。プロジェクトはオープンソース化され、視覚生成に関する研究を促進。 Comment

HF: https://huggingface.co/KlingTeam/SVG-T2I

元ポスト:

先行研究:

- [Paper Note] Latent Diffusion Model without Variational Autoencoder, Minglei Shi+, arXiv'25, 2025.10

- [Paper Note] Diffusion Transformers with Representation Autoencoders, Boyang Zheng+, arXiv'25, 2025.10

[Paper Note] PixelDiT: Pixel Diffusion Transformers for Image Generation, Yongsheng Yu+, arXiv'25, 2025.11

Paper/Blog Link My Issue

#ComputerVision #Transformer #DiffusionModel #ImageSynthesis #Pixel-based Issue Date: 2025-11-26 GPT Summary- PixelDiTは、オートエンコーダーを排除し、ピクセル空間での拡散プロセスを直接学習するエンドツーエンドモデルである。グローバルなセマンティクスとテクスチャの詳細を捉える二重レベルのトランスフォーマーアーキテクチャを採用し、効率的なトレーニングを実現。ImageNetで1.61のFIDを達成し、テキストから画像への生成にも拡張。GenEvalで0.74、DPG-benchで83.5を記録し、既存モデルを上回る性能を示した。 Comment

元ポスト:

[Paper Note] Kandinsky 5.0: A Family of Foundation Models for Image and Video Generation, Vladimir Arkhipkin+, arXiv'25, 2025.11

Paper/Blog Link My Issue

#ComputerVision #EfficiencyImprovement #Supervised-FineTuning (SFT) #ReinforcementLearning #FoundationModel #DiffusionModel #SmallModel #VideoGeneration/Understandings #VisionLanguageModel Issue Date: 2025-11-20 GPT Summary- Kandinsky 5.0は、高解像度画像と10秒動画合成のための最先端モデルで、3つのコアモデル(Image Lite、Video Lite、Video Pro)から構成される。データキュレーションライフサイクルのレビューや、自己教師ありファインチューニングや強化学習を用いた品質向上技術を取り入れ、高い生成速度とパフォーマンスを実現。オープンソースコードとトレーニングチェックポイントの提供により、研究コミュニティの発展に寄与することを目指す。 Comment

HF: https://huggingface.co/kandinskylab

元ポスト:

[Paper Note] MMaDA: Multimodal Large Diffusion Language Models, Ling Yang+, NeurIPS'25, 2025.05

Paper/Blog Link My Issue

#NLP #LanguageModel #ReinforcementLearning #MultiModal #DiffusionModel #NeurIPS #2D (Image) #text Issue Date: 2025-11-05 GPT Summary- MMaDAは、テキスト推論やマルチモーダル理解、テキストから画像生成に優れた性能を発揮する新しいマルチモーダル拡散基盤モデルです。主な革新点は、モダリティに依存しない統一された拡散アーキテクチャ、混合長チェーン・オブ・ソートによるファインチューニング戦略、そしてUniGRPOという統一ポリシー勾配ベースのRLアルゴリズムです。実験により、MMaDA-8Bは他のモデルを上回る性能を示し、事前トレーニングと事後トレーニングのギャップを埋める効果が確認されました。コードとトレーニング済みモデルはオープンソースで提供されています。 Comment

ポイント解説:

元ポスト:

[Paper Note] MetaMorph: Multimodal Understanding and Generation via Instruction Tuning, Shengbang Tong+, ICCV'25, 2024.12

Paper/Blog Link My Issue

#ComputerVision #LanguageModel #InstructionTuning #DiffusionModel #read-later #Selected Papers/Blogs #ICCV #ImageSynthesis Issue Date: 2025-10-20 GPT Summary- 本研究では、視覚的指示調整の新手法VPiTを提案し、LLMがテキストと視覚トークンを生成できるようにします。VPiTは、キュレーションされた画像とテキストデータからトークンを予測する能力をLLMに教え、視覚生成能力が向上することを示しました。特に、理解データが生成データよりも効果的に両方の能力に寄与することが明らかになりました。MetaMorphモデルを訓練し、視覚理解と生成で競争力のあるパフォーマンスを達成し、LLMの事前学習から得た知識を活用することで、視覚生成における一般的な失敗を克服しました。これにより、LLMが視覚理解と生成に適応できる可能性が示唆されました。 Comment

元ポスト:

[Paper Note] Learning an Image Editing Model without Image Editing Pairs, Nupur Kumari+, arXiv'25, 2025.10

Paper/Blog Link My Issue

#ComputerVision #DiffusionModel #VisionLanguageModel #2D (Image) #Editing #ImageSynthesis Issue Date: 2025-10-18 GPT Summary- 本研究では、ペアデータを使用せずに画像編集モデルをトレーニングする新しいパラダイムを提案。拡散モデルを展開し、視覚-言語モデル(VLM)からのフィードバックを活用して直接最適化を行う。生成画像の視覚的忠実性を保つために分布マッチング損失(DMD)を導入。標準ベンチマークで評価した結果、従来の教師ありペアデータを用いたモデルと同等の性能を達成し、RLベースの手法をも上回ることが示された。 Comment

元ポスト:

[Paper Note] Flow-GRPO: Training Flow Matching Models via Online RL, Jie Liu+, NeurIPS'25, 2025.05

Paper/Blog Link My Issue

#ComputerVision #ReinforcementLearning #NeurIPS #On-Policy #FlowMatching Issue Date: 2025-10-10 GPT Summary- Flow-GRPOは、オンライン強化学習をフローマッチングモデルに統合した新しい手法で、ODEをSDEに変換することでRL探索のための統計的サンプリングを実現し、デノイジングステップを削減してサンプリング効率を向上させる。実験結果では、テキストから画像へのタスクで性能が大幅に向上し、GenEvalの精度が63%から95%に、視覚的テキストレンダリングの精度が59%から92%に改善された。また、報酬ハッキングがほとんど発生せず、画像の質や多様性を損なうことなく報酬が増加した。

[Paper Note] JetFormer: An Autoregressive Generative Model of Raw Images and Text, Michael Tschannen+, ICLR'25

Paper/Blog Link My Issue

#ComputerVision #Transformer #Architecture #ICLR #read-later #NormalizingFlow Issue Date: 2025-08-17 GPT Summary- JetFormerは、画像とテキストの共同生成を効率化する自己回帰型デコーダー専用のトランスフォーマーであり、別々にトレーニングされたコンポーネントに依存せず、両モダリティを理解・生成可能。正規化フローモデルを活用し、テキストから画像への生成品質で既存のベースラインと競合しつつ、堅牢な画像理解能力を示す。JetFormerは高忠実度の画像生成と強力な対数尤度境界を実現する初のモデルである。 Comment

openreview: https://openreview.net/forum?id=sgAp2qG86e

画像をnormalizing flowでソフトトークンに変換し、transformerでソフトトークンを予測させるように学習することで、テキストと画像を同じアーキテクチャで学習できるようにしました、みたいな話っぽい?おもしろそう

[Paper Note] AR-GRPO: Training Autoregressive Image Generation Models via Reinforcement Learning, Shihao Yuan+, arXiv'25

Paper/Blog Link My Issue

#ComputerVision #Transformer #ReinforcementLearning #GRPO #On-Policy #Encoder-Decoder Issue Date: 2025-08-12 GPT Summary- AR-GRPOは、自己回帰画像生成モデルにオンライン強化学習を統合した新しいアプローチで、生成画像の品質を向上させるためにGRPOアルゴリズムを適用。クラス条件およびテキスト条件の画像生成タスクで実験を行い、標準のARモデルと比較して品質と人間の好みを大幅に改善した。結果は、AR画像生成における強化学習の有効性を示し、高品質な画像合成の新たな可能性を開く。 Comment

元ポスト:

[Paper Note] Janus-Pro: Unified Multimodal Understanding and Generation with Data and Model Scaling, Xiaokang Chen+, arXiv'25, 2025.01

Paper/Blog Link My Issue

#ComputerVision #NLP #MultiModal #OpenWeight #VisionLanguageModel #2D (Image) #UMM #One-Line Notes #ImageSynthesis Issue Date: 2025-01-28 GPT Summary- Janus-Proは、最適化されたトレーニング戦略、拡張されたデータ、より大きなモデルサイズを取り入れたJanusの進化形。これにより、マルチモーダル理解と画像生成の安定性において顕著な進歩を実現。研究成果は公開されており、さらなる探究を促すことが期待される。 Comment

DeepSeekによる新たなUMM、Janus-Proが本日リリース。MIT License

Janus-Proのパフォーマンス。

github上でのパフォーマンスの図解から引用。マルチモーダル(テキスト+画像)の理解に関するベンチマークでLLaVA超え。GenEval, DPG Benchと呼ばれる画像生成ベンチマークでDALL-E 3超え。

テクニカルレポート中での詳細から引用。どのベンチマークでも基本的に最高性能なように見える。

テクニカルレポート:

https://github.com/deepseek-ai/Janus/blob/main/janus_pro_tech_report.pdf

ベンチマーク:

- [Paper Note] GenEval: An Object-Focused Framework for Evaluating Text-to-Image Alignment, Dhruba Ghosh+, NeurIPS'23

- [Paper Note] ELLA: Equip Diffusion Models with LLM for Enhanced Semantic Alignment, Xiwei Hu+, arXiv'24

[Paper Note] Shadows Don't Lie and Lines Can't Bend Generative Models don't know Projective Geometry...for now, Ayush Sarkar+, CVPR'24, 2023.11

Paper/Blog Link My Issue

#ComputerVision #Analysis #DiffusionModel #CVPR #ImageSynthesis #GeometryUnderstanding Issue Date: 2025-10-24 GPT Summary- 生成モデルはリアルな画像を生成するが、幾何学的特徴において実際の画像と異なることを示す。事前に選別された生成画像を用いて、幾何学的特性に基づく分類器が生成画像を高精度で識別できることを確認。3つの分類器を使用し、画像の透視場、線、物体と影の関係を分析。これにより、生成画像の検出精度が向上し、現在の生成器は実際の画像の幾何学的特性を再現できないと結論付ける。 Comment

[Paper Note] Controllable Generation with Text-to-Image Diffusion Models: A Survey, Pu Cao+, arXiv'24

Paper/Blog Link My Issue

#Survey #ComputerVision #Controllable #NLP #DiffusionModel Issue Date: 2025-08-07 GPT Summary- 拡散モデルはテキスト誘導生成において大きな進展を遂げたが、テキストのみでは多様な要求に応えられない。本調査では、T2I拡散モデルの制御可能な生成に関する文献をレビューし、理論的基盤と実践的進展をカバー。デノイジング拡散確率モデルの基本を紹介し、制御メカニズムを分析。生成条件の異なるカテゴリに整理した文献リストを提供。

[Paper Note] GenEval: An Object-Focused Framework for Evaluating Text-to-Image Alignment, Dhruba Ghosh+, NeurIPS'23

Paper/Blog Link My Issue

#ComputerVision #NLP #Dataset #Evaluation #NeurIPS #read-later #Selected Papers/Blogs Issue Date: 2025-09-11 GPT Summary- テキストから画像への生成モデルの自動評価方法「GenEval」を提案。物体の共起、位置、数、色などの特性を評価し、現在の物体検出モデルを活用して生成タスクを分析。最近のモデルは改善を示すが、複雑な能力には課題が残る。GenEvalは失敗モードの発見にも寄与し、次世代モデルの開発に役立つ。コードは公開中。 Comment

openreview: https://openreview.net/forum?id=Wbr51vK331¬eId=NpvYJlJFqK

[Paper Note] Adding Conditional Control to Text-to-Image Diffusion Models, Lvmin Zhang+, arXiv'23

Paper/Blog Link My Issue

#ComputerVision #Controllable #NLP #MultiModal Issue Date: 2025-08-07 GPT Summary- ControlNetは、テキストから画像への拡散モデルに空間的な条件制御を追加するためのニューラルネットワークアーキテクチャであり、事前学習済みのエンコーディング層を再利用して多様な条件制御を学習します。ゼロ畳み込みを用いてパラメータを徐々に増加させ、有害なノイズの影響を軽減します。Stable Diffusionを用いて様々な条件制御をテストし、小規模および大規模データセットに対して堅牢性を示しました。ControlNetは画像拡散モデルの制御における広範な応用の可能性を示唆しています。 Comment

ControlNet論文

Table and Image Generation for Investigating Knowledge of Entities in Pre-trained Vision and Language Models, ACL'23

Paper/Blog Link My Issue

#ComputerVision #NaturalLanguageGeneration #NLP #LanguageModel #TabularData #ACL Issue Date: 2023-07-15 GPT Summary- 本研究では、Vision&Language(V&L)モデルにおけるエンティティの知識の保持方法を検証するために、テーブルと画像の生成タスクを提案します。このタスクでは、エンティティと関連する画像の知識を含むテーブルを生成する第一の部分と、キャプションとエンティティの関連知識を含むテーブルから画像を生成する第二の部分があります。提案されたタスクを実行するために、Wikipediaの約20万のinfoboxからWikiTIGデータセットを作成しました。最先端のV&LモデルOFAを使用して、提案されたタスクのパフォーマンスを評価しました。実験結果は、OFAが一部のエンティティ知識を忘れることを示しています。

Learning to Imagine: Visually-Augmented Natural Language Generation, ACL'23

Paper/Blog Link My Issue

#ComputerVision #NaturalLanguageGeneration #NLP #MultiModal #DiffusionModel #ACL Issue Date: 2023-07-15 GPT Summary- 本研究では、視覚情報を活用した自然言語生成のためのLIVEという手法を提案しています。LIVEは、事前学習済み言語モデルを使用して、テキストに基づいて場面を想像し、高品質な画像を合成する方法です。また、CLIPを使用してテキストの想像力を評価し、段落ごとに画像を生成します。さまざまな実験により、LIVEの有効性が示されています。コード、モデル、データは公開されています。 Comment

>まず、テキストに基づいて場面を想像します。入力テキストに基づいて高品質な画像を合成するために拡散モデルを使用します。次に、CLIPを使用して、テキストが想像力を喚起できるかを事後的に判断します。最後に、私たちの想像力は動的であり、段落全体に1つの画像を生成するのではなく、各文に対して合成を行います。

興味深い

[Paper Note] ViCo: Plug-and-play Visual Condition for Personalized Text-to-image Generation, Shaozhe Hao+, arXiv'23, 2023.06

Paper/Blog Link My Issue

#ComputerVision #NLP #Personalization #DiffusionModel Issue Date: 2023-06-16 GPT Summary- ViCoは、個別化されたテキストから画像を生成する軽量な拡散モデルで、従来のモデルのファインチューニングを不要とし、柔軟でスケーラブルな展開を実現します。ViCoは、画像アテンションモジュールを通じて視覚セマンティクスを統合し、約6%のパラメータ学習で最先端モデルと同等の性能を達成。個別化テキストからの画像生成における有効性を示し、今後の展望が期待されます。

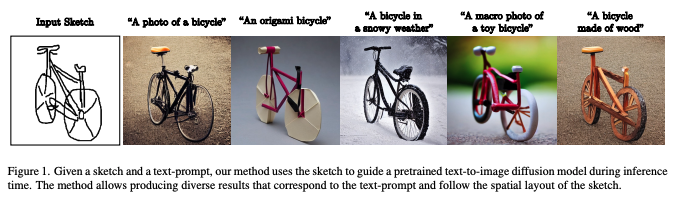

Sketch-Guided Text-to-Image Diffusion Models, Andrey+, Google Research, SIGGRAPH'23

Paper/Blog Link My Issue

#NeuralNetwork #ComputerVision #NLP #SIGGRAPH #One-Line Notes #ImageSynthesis Issue Date: 2022-12-01 Comment

スケッチとpromptを入力することで、スケッチ biasedな画像を生成することができる技術。すごい。

[Paper Note] High-Resolution Image Synthesis with Latent Diffusion Models, Robin Rombach+, CVPR'22, 2021.12

Paper/Blog Link My Issue

#ComputerVision #VariationalAutoEncoder #CVPR #Selected Papers/Blogs #Encoder-Decoder #ImageSynthesis #U-Net Issue Date: 2025-10-10 GPT Summary- 拡散モデル(DMs)は、逐次的なデノイジングオートエンコーダを用いて画像生成プロセスを効率化し、最先端の合成結果を達成。従来のピクセル空間での訓練に比べ、強力な事前訓練されたオートエンコーダの潜在空間での訓練により、計算リソースを削減しつつ視覚的忠実度を向上。クロスアテンション層を導入することで、テキストやバウンディングボックスに基づく柔軟な生成が可能となり、画像インペインティングや無条件画像生成などで競争力のある性能を発揮。 Comment

ここからtext等による条件付けをした上での生成が可能になった(らしい)

日本語解説:

https://qiita.com/UMAboogie/items/afa67842e0461f147d9b

前提知識:

- [Paper Note] Denoising Diffusion Probabilistic Models, Jonathan Ho+, NeurIPS'20, 2020.06

[Paper Note] Diffusion Models Beat GANs on Image Synthesis, Prafulla Dhariwal+, NeurIPS'21 Spotlight, 2021.05

Paper/Blog Link My Issue

#NeuralNetwork #ComputerVision #DiffusionModel #NeurIPS #Selected Papers/Blogs #Encoder-Decoder #ScoreMatching #U-Net Issue Date: 2025-10-10 GPT Summary- 拡散モデルが最先端の生成モデルを上回る画像サンプル品質を達成。無条件画像合成ではアーキテクチャの改善、条件付き画像合成では分類器のガイダンスを用いて品質向上。ImageNetでのFIDスコアは、128×128で2.97、256×256で4.59、512×512で7.72を達成し、BigGAN-deepに匹敵。分類器のガイダンスはアップサンプリング拡散モデルと組み合わせることでさらに改善され、256×256で3.94、512×512で3.85を記録。コードは公開中。 Comment

openreview: https://openreview.net/forum?id=AAWuCvzaVt

日本語解説: https://qiita.com/UMAboogie/items/160c1159811743c49d99

バックボーンとして使われているU-Netはこちら:

- [Paper Note] U-Net: Convolutional Networks for Biomedical Image Segmentation, Olaf Ronneberger+, MICCAI'15, 2015.05

Building a hill-climbing machine: Launching seven new MAI models, Mustafa Suleyman, MAI, 2026.06

Paper/Blog Link My Issue

#Article #LanguageModel #AIAgents #Blog #Coding #Proprietary #TTS #ImageSynthesis #Transcript #Author Thread-Post Issue Date: 2026-06-03 Comment

- MAI-Thinking-1: Building a Hill-Climbing Machine, Microsoft, 2026.06

元ポスト:

関連:

Introducing 1-bit and Ternary Bonsai Image 4B: Image Generation for Local Devices, PrismML, 2026.05

Paper/Blog Link My Issue

#Article #ComputerVision #DiffusionModel #SmallModel #Selected Papers/Blogs #One-Line Notes #ImageSynthesis #LowPrecision #Author Thread-Post Issue Date: 2026-05-27 Comment

元ポスト:

HF: https://huggingface.co/collections/prism-ml/bonsai-image

Ternary Weight {-1, 0, 1}による画像生成モデル

より安全で透明性の高い AI エコシステムに向けて、コンテンツ来歴の取り組みを前進, OpenAI, 2026.05

Paper/Blog Link My Issue

#Article #ComputerVision #Proprietary #2D (Image) #One-Line Notes #ImageSynthesis #AI Detector #Author Thread-Post Issue Date: 2026-05-27 Comment

元ポスト:

画像生成にSynthID追加、また、画像がChatGPT, Codex, OpenAI APIから生成されたものかを判定するツールの一般向けプレビューを開始

https://openai.com/ja-JP/research/verify/

SenseNova-U1, OpenSenseNova, 2026.04

Paper/Blog Link My Issue

#Article #ComputerVision #MultiModal #read-later #UMM #ImageSynthesis #Pixel-based #Author Thread-Post Issue Date: 2026-04-28 Comment

元ポスト:

後ほどプレプリントが出るようである

公式ポスト:

Introducing ChatGPT Images 2.0: A new era of image generation, OpenAI, 2026.04

Paper/Blog Link My Issue

#Article #ComputerVision #NLP #ChatGPT #Proprietary #Selected Papers/Blogs #ImageSynthesis #Initial Impression Notes #Author Thread-Post Issue Date: 2026-04-22 Comment

元ポスト:

めとゃめちゃ良くなってそう

関連:

関連:

Artificial Analysisによる評価(SoTA):

Introducing ERNIE‑Image, Baidu, 2026.04

Paper/Blog Link My Issue

#Article #ComputerVision #NLP #Transformer #DiffusionModel #OpenWeight #Selected Papers/Blogs #2D (Image) #One-Line Notes #ImageSynthesis #Author Thread-Post Issue Date: 2026-04-15 Comment

HF: https://huggingface.co/baidu/ERNIE-Image

ERNIEからtext-to-imageモデルがOpenWeightモデルとしてリリース。ベンチマークとしては公式ブログ上ではOpenWeightモデルの中でトップで、nano banana 2.0に匹敵するようなスコアが出ているように見える

FLUX.2-klein-9B, black-forest-labs, 2026.01

Paper/Blog Link My Issue

#Article #ComputerVision #EfficiencyImprovement #NLP #Transformer #SmallModel #Selected Papers/Blogs #2D (Image) #Editing #One-Line Notes Issue Date: 2026-03-15 Comment

元ポスト:

github: https://github.com/black-forest-labs/flux2

そもそも2025年11月にリリースされているFLUX.2は結構色々なところで名前を見かけるのでおさえておいたほうが良いかもしれない

https://bfl.ai/blog/flux-2

kleinはFLUX.2シリーズの中で最も軽量なモデルとのこと。2ヶ月程度で既に110k DLされている。

Claude now creates interactive charts, diagrams and visualizations, Claude, 2026.03

Paper/Blog Link My Issue

#Article #NLP #LanguageModel #Proprietary #Reference Collection #Initial Impression Notes #Visualization Issue Date: 2026-03-14 Comment

かなり良いらしい(小並感)

元ポスト:

たとえばMLAとDSAの図解を作らせたら以下:

MuonとAdam(W)の違いの解説を作らせたら以下:

Build with Nano Banana 2, our best image generation and editing model, Google, 2026.02

Paper/Blog Link My Issue

#Article #ComputerVision #NLP #Proprietary #Editing #ImageSynthesis Issue Date: 2026-02-28 Comment

元ポスト:

Accelerating Diffusion Models with an Open, Plug-and-Play Offering, Nvidia, 2026.01

Paper/Blog Link My Issue

#Article #ComputerVision #EfficiencyImprovement #Tools #NLP #Library #DiffusionModel #Distillation #PostTraining #2D (Image) #Editing #4D (Video) #TextToVideoGeneration #ImageToTextGeneration Issue Date: 2026-01-29 Comment

元ポスト:

self forcingも実装されている

- [Paper Note] Self Forcing: Bridging the Train-Test Gap in Autoregressive Video Diffusion, Xun Huang+, NeurIPS'25

GLM-Image: Auto-regressive for Dense-knowledge and High-fidelity Image Generation, Z.ai, 2026.01

Paper/Blog Link My Issue

#Article #ComputerVision #NLP #LanguageModel #MultiModal #DiffusionModel #OpenWeight #Editing Issue Date: 2026-01-14 Comment

元ポスト:

Ming-flash-omni-Preview, inclusionAI, 2025.10

Paper/Blog Link My Issue

#Article #ComputerVision #NLP #LanguageModel #MultiModal #SpeechProcessing #OpenWeight #AutomaticSpeechRecognition(ASR) #Architecture #MoE(Mixture-of-Experts) #Selected Papers/Blogs #VideoGeneration/Understandings #Editing #TTS #Routing #UMM #Omni #Sparse #ImageSynthesis #Initial Impression Notes Issue Date: 2025-10-28 Comment

元ポスト:

過去一番多くのタグを付与した気がするが、果たして大規模、Omniモーダルかつ、UMMにしたことによる恩恵(=様々なモダリティを統一された空間上に学習させる恩恵)はどの程度あるのだろうか?

アーキテクチャを見ると、モダリティごとに(モダリティ単位でのバイアスがかかった)Routerが用意されexpertにルーティングされるような構造になっている。

OmniモーダルでUMMを大規模にスクラッチから事前学習:

- [Paper Note] ERNIE 5.0 Technical Report, Haifeng Wang+, arXiv'26, 2026.02

LongCat-Video Techcal Report, Meituan LongCat Team, 2025.10

Paper/Blog Link My Issue

#Article #ComputerVision #Transformer #DiffusionModel #LongSequence #VariationalAutoEncoder #OpenWeight #VideoGeneration/Understandings Issue Date: 2025-10-26 Comment

元ポスト:

HF: https://huggingface.co/meituan-longcat/LongCat-Video

公式ポスト:

Introducing Stable Diffusion 3.5, StabilityAI, 2024.10

Paper/Blog Link My Issue

#Article #ComputerVision #Transformer #DiffusionModel #Blog #OpenWeight #Selected Papers/Blogs Issue Date: 2025-10-10 Comment

SD3.5

MagicBench, ByteDance-Seed, 2025.09

Paper/Blog Link My Issue

#Article #ComputerVision #NLP #Dataset #LanguageModel #Evaluation #UMM Issue Date: 2025-09-19 Comment

元ポスト:

英文と中文両方存在する

Introducing Gemini 2.5 Flash Image, our state-of-the-art image model, Google, 2025.08

Paper/Blog Link My Issue

#Article #ComputerVision #NLP #Blog #Proprietary #Editing Issue Date: 2025-08-28 Comment

nano banana

ベストプラクティス:

プロンプトガイドと戦略:

https://ai.google.dev/gemini-api/docs/image-generation?hl=ja#prompt-guide

元ポスト: